Jadu, dagens skärm-upplösning är för låg. När upplösningen är på den nivå där man inte längre behöver antialiasing skulle jag säga är max. Då kan ögat inte längre urskilja dem enskilda punkterna. Om man räknar hur många ppi som en människa kan (källa) se så får man fram 530ppi från 50cm avstånd. För en 22" 16:9 skärm är det 10229x5618. En iphone4 skärm ligger på 326ppi som jämförelse, jag testade precis och en aliaserad cirkel är inte helt jämn utan taggig på 50cm.

Det är inte så lätt som att säga att ögat har tre koner vilka ser tre olika färger, en kons våglängdsspektra är brett och överlappar andras och kan se flera "primärfärger".

Här kan vi se hur de olika konerna ser färger. Den längsta staven som ser "rött" kan även uppfatta grönt och även lite blått, men ser rött starkast.

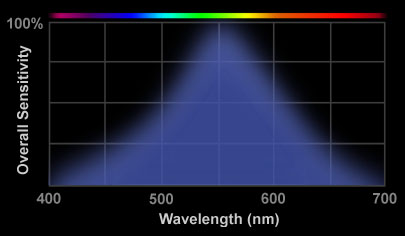

Här är en graf som visar hur känsligt ögat är för vissa färger, vi ser tre tydliga toppar "RGB" vilket vi bygger våra tryck och visningstekniker på.

Man kan även se att ögat ser röd som en svagare färg än t.ex. blått. Det är därför typ datormöss, standby-LEDs och ubåtsbelysning är röda för att det inte inte irriterar ögat i mörka miljöer.

"Meh hallåååh, NAJTVISHON GÅGGELS är ju grööna!! Grön är starkaaasssteeeh!"

Det stämmer också, men då pratar vi om stavar. Tittar vi på grafen nedanför ser vi tydligt att tapparna är känsligast för gröna våglängder.

Fördelen med grönt i NV är att man kan visa en tydlig bild med så lite ström som möjligt och få en dräglig batteritid, eftersom att man kan gå så lågt i ljusstyrka så minimerar man också spilljus vilket är viktigt för ljusdisciplin.

Angående antalet färger så brukar man säga att man måste upp till 150 steg på en gråskala för att det ska flyta ihop för dem mest tränade ögonen (redan 100 är svårt att se skillnad på). Detta betyder att ögat kan urskilja ca 10 miljoner nyanser (150x150x150) från varandra om man ska ta i. Förmågan att urskilja färger sitter i hjärnan och inte ögonen, därför kan det bli lite svårt att mäta. Men det är vad man har kommit fram till i tester.

Varför då 255 nivåer av respektive RGB? Det blev helt enkelt så när man ville få ut fler färger pga det tekniska. Vi är väl familjära med 16bitars inställning i windows och hur förfärligt det kan se ut, 24 bitar ska det ju vara! 16 bitar innebär 6 bitar per färgkanal!!

6 bitar kan innehålla 64 värden, vi vet att 64 steg är begränsat för våran syn vi vill ju ha över 100 steg! Nästa möjliga steg upp är 8 bitar som kan innehålla 256 värden. 256^3 = typ 16,77mil. Enkelt va!

"Meh hallåååh, asså kolla! RGB 8bitar är ju värsta begränsade färjrymden jue! 16,2miljoner färger är ju fan ingentinngee. Man måste ju ha 16 bitar per kanal i photoshop oom mann e seriöööös!!"

16 bitar kan hålla 65536 värden, med RGB får vi ut mer än 281 triljoner färger (281474976710656 st närmare bestämt). Det är sant! Man kan behöva jobba i en större färgrymd för att inte drabbas av färgkomprimering när man redigerar bilder.

Här är originalbilden, vi kan se att svart inte är max svart och vitt inte är max vit

Men när vi har korrigerat i 8bit så får vi det här problemet, vi kan se att det är som stolpar i histogrammet och färginformation saknas.

Gör vi samma sak i en större färgrymd så får vi det här resultatet tack vare interpolationen som 16 bitar kan ge.

Frågor?