@Tomika: Precis som @Gramner säger:

Skrivet av Gramner:

Tillverkningskostnaden för en wafer (dvs kostnad per area) är högre med nyare tillverkningstekniker (dyrare utrustning och ofta fler steg i tillverkningsprocessen).

Att kostnaden för top-of-the line produkter har gått upp har mest att göra med att konsumenterna är villiga att betala för det, så varför sälja billigt?

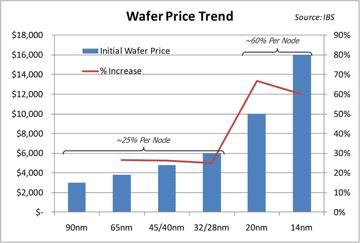

-så har kostnaden per färdigproducerad wafer ökat markant de senaste noderna:

Detta som resultat av att det blir allt svårare att krympa varje nod i och med att vi kommer närmare och närmare kiselets fysiska gränser där "strömmläckaget" blir allt större, vilket i sin tur motverkar de förbättringar som krympning av noder ger.

Dessa svårigheter tvingar Fab:arna att använda sig ut av mer exotiska lösningar för att bland annat minska läckaget, som tex Fin FET.

Detta för i sin tur med sig svårare tillverkning som gör att fler tillverkningssteg krävs för att bland annat skapa fenorna i fin FET, vilket man kan se i statistiken:

Problemet med fler tillverkningssteg är att det ökar risken för fel i wafern, varje steg har en viss risk för att göra ett fel som i sin tur kan göra kretsen oanvändbar. Vid ökning av antalet steg så öker även risken för fel på wafern, vilket resulterar i färre "godkända" kretsar som i sin tur gör det dyrare för tex Nvidia att köpa in kretsar ifrån TSMC.

Det finns dock nya tekniker som kommer för att motverka denna domedag, Som tex EUV "Extreme ultraviolet lithography". EUV har kortare våglängd på ljuset som används för att skapa transistorerna jämfört med tidigare tekniker och det gör att transistorerna kan skapas med bättre precision och i sin tur lättare krympa noder. Fördelarna med EUV gör att kostnaden per wafer rör sig nedåt emot prisnivåerna vid föregående noder:

Ett annat trick som används i bland annat AMDs zen arkitektur, är att i stället för att göra kretsarna större för att öka prestandan, så gör de många små kretsar som de sedan sätter ihop för att sedan fungera som en krets med hjälp av tex infinity fabric i det här fallet. Detta ger ungefär samma prestanda som monokretsar, med fördelen att det är mycket enklare och billigare att producera många små kretsar, än det är att producera få stora. Det kommer som tidigare sagt alltid ske ett visst antal "fatal" produktionsfel på en specifik nod som gör kretsen oanvändbar, dessa fel kan dock ske på olika ställen på wafern. Säg till exempel att en viss nod ger i genomsnitt 10 "fatala" fel och man gör en jättekrets av hela wafern, då kommer det 0% av gångerna bli en fungerande krets, men om man gör 100 st mindre kretsar så kommer max tio st av dem att bli oanvändbara, vilket ger minst 90% i yield. Det är på detta sätt som AMD nu har kunnat presentera sin 32-kärniga threadripper, den består nämligen av ett antal mindre kretsar som sedan har blivit ihopsatta, medans Intel 28-kärniga processorer är en enda så kallad monolithic krets.

Sammanfattningsvis så ja, kostnaden för själva kislet (plankan, för att använda din liknelse) som fabarna köper in är antagligen desamma som tidigare, oavsett så är inte det som har gjort så att priset på gpu och cpu har ökat, utan svårigheterna att kunna göra fler "godkända" sågspån av varje planka, och dessa svårigheterna kostar mycket pengar att få bukt med.

andra anledningar är såklart mining, höga priserna på DRAM (som även den påverkas av svårigheterna vid krympning av noder)

och frånvaron av konkurrens ifrån AMD i flaggskeppsklassernas grafikkort, (vilket förhoppningsvis kommer att ändras när AMD börjar tillämpa samma strategi som i zen med IF och många ihopsatta kretsar med mindre yta.)

tack